Claude に社内情報を入れても大丈夫?|非エンジニアが最初に確認すべきセキュリティの基本

冒頭

従業員25人の人材派遣会社で、経理と総務を兼任している方がいる。Claude Cowork(クロード・コワーク)を使えば月末の請求書処理が楽になると聞いて試してみたいが、1つだけ引っかかっていることがある。「取引先の会社名や金額を入力したら、どこかに漏れないか?」という不安だ。

この不安は、Claude の導入を検討するほぼすべての方が最初に感じるものだ。実際、Claude Works に届く相談の中で最も多いのが「安全性」に関する質問で、全体の約4割を占めている。

結論から言えば、プラン選びと入力ルールを正しく押さえれば、Claudeは安全に業務利用できる。この記事では、何を入力してよくて、何を避けるべきか、どのプランを選べばいいか、社内でどんなルールを作ればいいかを整理する。記事の最後に、社内AI利用ガイドラインのテンプレートを無料で用意している。

Anthropic社はあなたの入力データをどう扱っているか

まず、Anthropic(アンソロピック)社が公表しているデータの扱い方を整理する。2026年4月時点の情報だ。

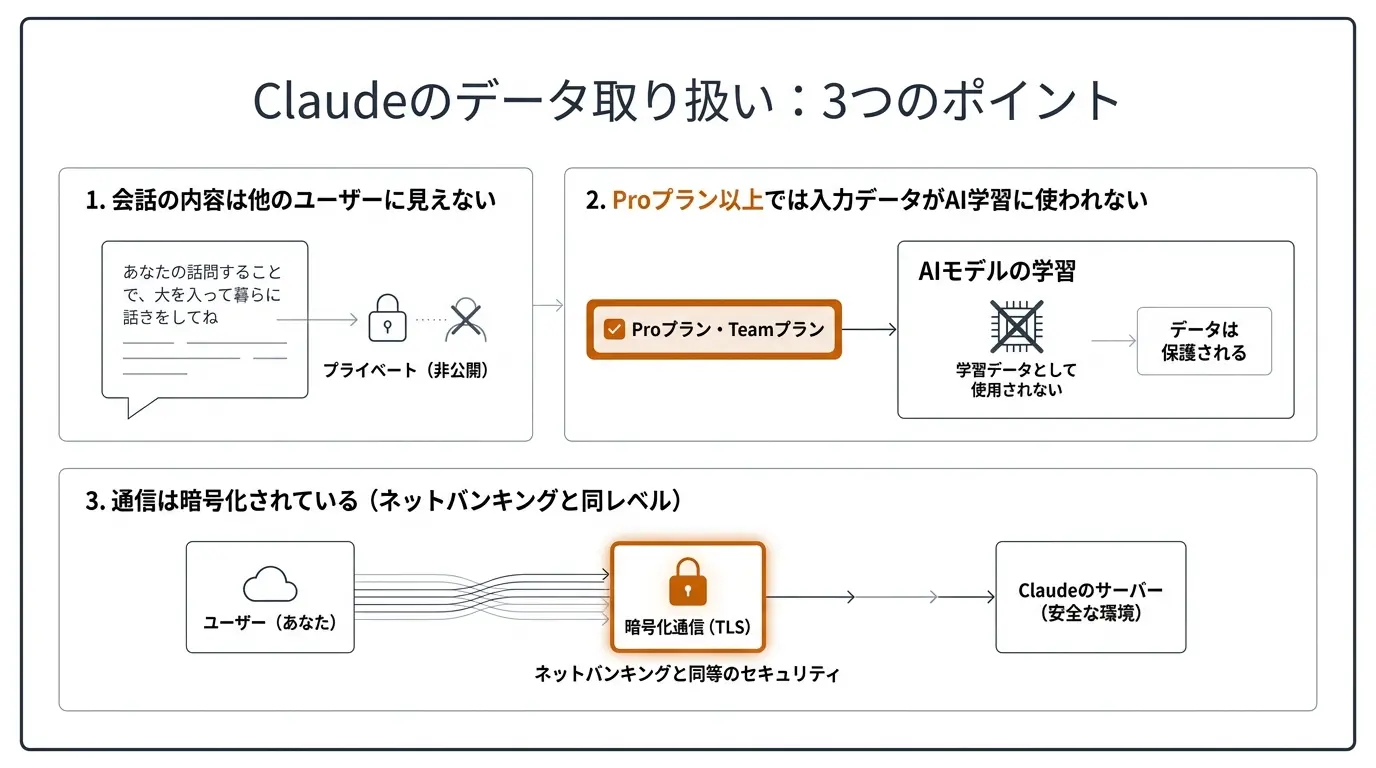

あなたの会話は他のユーザーには見えない。あなたがClaudeに入力した内容は、あなたのアカウントだけに紐づいている。他の誰かがClaude を使ったときに、あなたの入力内容が回答に混ざることはない。

Pro プラン(月額約3,000円)以上では、入力データがAIモデルの学習(トレーニング)に使われない。Anthropic社はこれを利用規約で明示している。つまり、あなたが入力した売上データや取引先名が、将来のClaude の回答に影響を与えることはない。

ただし、Free(無料)プランでは事情が異なる。無料プランの入力内容は、AIの改善のために使われる可能性があるとAnthropic社は説明している。仕事のデータを扱うなら、Pro プラン以上を選ぶことが前提になる。

- あなたのパソコンとClaude のサーバー間の通信は暗号化されている。これはネットバンキングや通販サイトの決済ページと同じ仕組みだ。通信途中で第三者に内容を盗み見られるリスクは極めて低い。

プランごとのセキュリティレベルを比較する

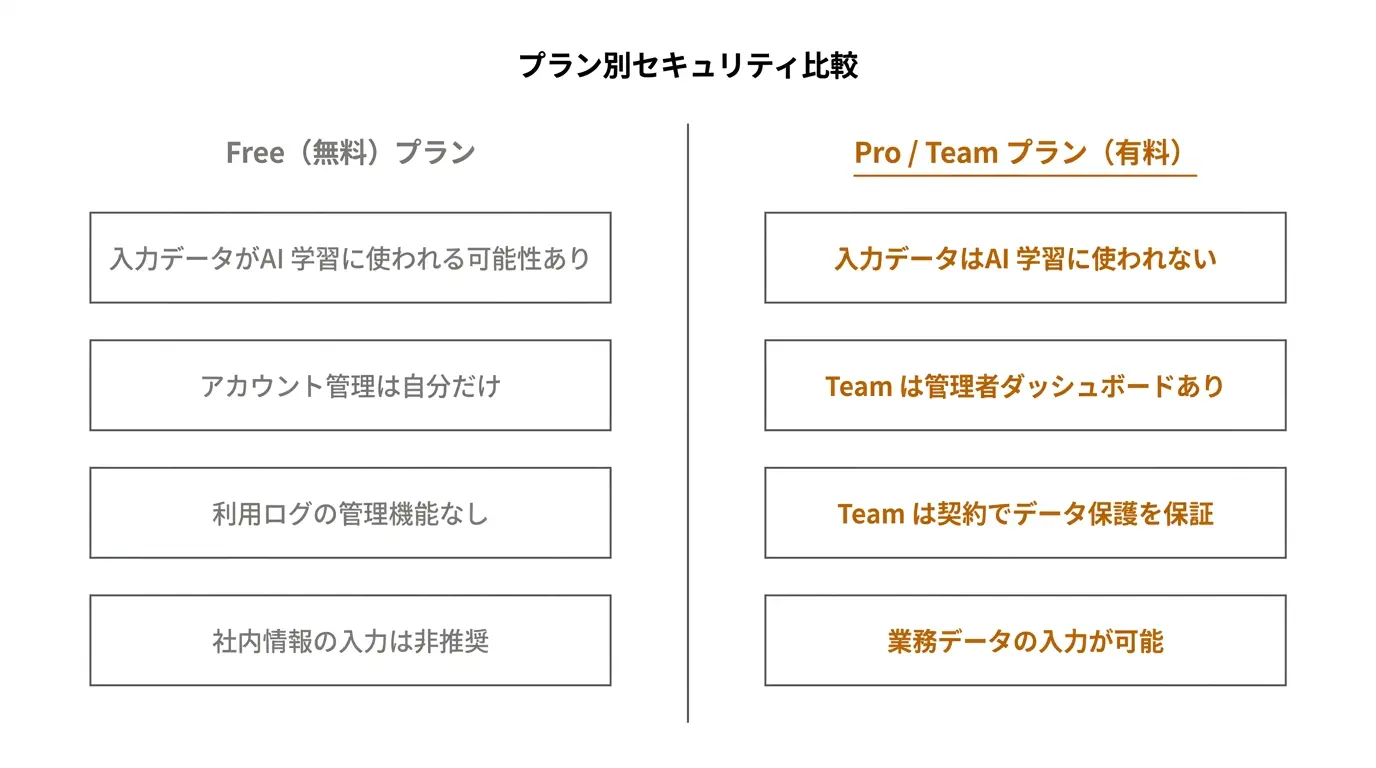

料金プランによって、セキュリティの水準が変わる。仕事で使う場合に重要な違いを整理する。

Free(無料)プランは、入力データがAIの学習に使われる可能性がある。個人的な調べものや文章の練習には問題ないが、会社の売上、顧客名、取引条件などは入力しないほうがいい。

Pro(月額約3,000円)プランは、入力データがAI学習に使われない。個人事業主や、まず1人で試す経営者に向いている。業務データを入力しても、そのデータがClaude の学習に使われることはない。

Team(1人あたり月額約4,500円、5人から)プランは、Pro のセキュリティに加え、管理者機能がつく。誰がどれだけ使っているかを把握できる。さらに、Anthropic社とのビジネス契約でデータ保護が明文化される。複数人で導入する中小企業には、このプランが安心だ。

Enterprise(法人見積もり)プランは、SSO(社内の共通ログイン)、監査ログ(いつ誰が何を入力したかの記録)、専任サポートがつく。100人以上の組織向けだ。

まとめると、仕事で使うならPro以上が必須、チームで使うならTeam以上が推奨、ということになる。

入力してよいもの、避けるべきもの

プランを正しく選んでも、何でもかんでも入力していいわけではない。ここが最も実務で重要なポイントだ。

入力してOKなもの(Pro / Team プラン前提)

- 社内の業務文書(報告書、議事録、企画書の下書き)

- 自社の売上データ、経費データ(集計・分析目的)

- 取引先名を含む業務メールの下書き

- 自社サービスの説明資料

- 採用の求人票、面接質問リスト

- 社内規程、マニュアルの下書き

- 一般に公開されている情報(Webサイトの内容、プレスリリース等)

入力を避けるべきもの(どのプランでも共通)

- 個人のマイナンバー

- クレジットカード番号

- 銀行口座の暗証番号・ログインパスワード

- 医療情報(患者のカルテ、診断結果)

- 未公開の特許情報、M&A情報

- NDA(秘密保持契約)で「第三者サービスへの入力禁止」と定められている情報

判断に迷うもの(ケースバイケース)

顧客の個人情報(氏名・電話番号・メールアドレス) → 可能であれば匿名化する(「A社の田中様」→「A社の担当者様」) → Team プラン以上で、社内ルールを定めた上で入力するのが安全

財務諸表、決算データ → 上場企業の未公開決算情報は入力しない → 非上場の中小企業であれば、Pro 以上のプランで社内利用は問題ない場合が多い

契約書の内容 → 自社と取引先の契約書は、NDA条項を確認した上で入力する → 「第三者への開示禁止」条項にAIサービスが含まれるかは、法務に確認するのが確実

社内でAI利用ルールを作る方法

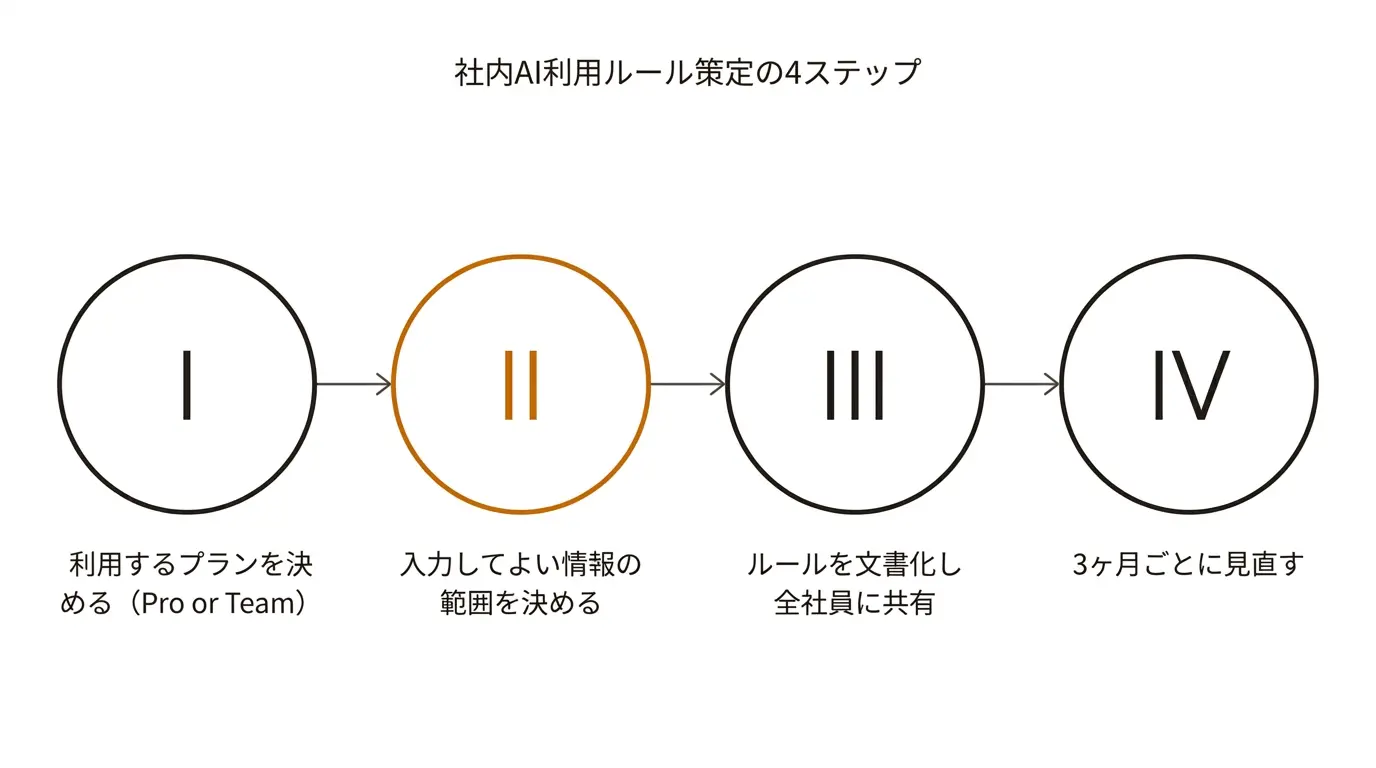

Claude を安全に業務利用するには、「個人の判断に任せない」ことが大事だ。社内でシンプルなルールを作っておけば、安心して使える。

利用するプランを決める。1人で使うならPro、複数人ならTeam。Free プランで業務データを扱うのは禁止、と明確にする。

入力してよい情報の範囲を決める。前のセクションの「OK / NG / ケースバイケース」を参考に、自社に合わせてリストを作る。迷うものは「上長に確認」とするのが実務的だ。

ルールを文書化し、全社員に共有する。A4で1枚、10項目以内が理想的だ。長すぎると誰も読まない。

3ヶ月ごとに見直す。AI ツールの仕様や料金は頻繁に変わる。最新の情報に合わせてルールをアップデートする。

ルールの具体例を1つ示す。

社内AI利用ガイドライン(例)

- 業務でAIツール(Claude等)を使う場合は、会社が契約したアカウントを使うこと

- 無料プランで業務データを入力しないこと

- 以下の情報はAIに入力しないこと: マイナンバー、クレジットカード番号、パスワード、患者情報、未公開の財務情報

- 顧客の個人情報を入力する場合は、可能な限り匿名化すること

- NDAで「第三者サービスへの入力禁止」とされている情報は入力しないこと

- AIの出力をそのまま社外に送る前に、事実確認を行うこと

- 判断に迷う場合は、上長に確認すること

この7項目があるだけで、「使っていいのか分からないから使わない」という状態を防げる。ルールがあれば、社員は安心してClaude を活用できる。

他のAIサービスと比べて、Claude の安全性はどうか

Claude の競合であるChatGPT(OpenAI社)やGemini(Google社)と比較してみる。

有料プランでの入力データ取り扱いについて。ChatGPT Plus も、有料プランでは入力データをAI学習に使わない設定がある。Gemini Advanced も同様の方針を公表している。この点では、主要なAIサービスに大きな差はない。

Anthropic社が他社と異なる点が1つある。Anthropic社は「Constitutional AI」(憲法AI)というアプローチで安全性を設計の中心に据えていることを強調している。これは、AIが有害な出力をしないように、設計段階からガードレール(安全柵)を組み込む手法だ。

ただし正直に言えば、「どのAIサービスが最も安全か」を一概に断定するのは難しい。重要なのは、どのサービスを選ぶにしても、有料プランを使う、入力ルールを決める、という基本を押さえることだ。

まとめ

Claude を仕事で安全に使うためのポイントは3つだ。1つ目。Proプラン以上を使う(入力データがAI学習に使われない)。2つ目。マイナンバーやパスワードなどの超機密情報は入力しない。3つ目。社内で入力ルールを決めて共有する。この3つを押さえれば、Claudeは安心して業務に活用できる。完璧なセキュリティは存在しないが、ルールを決めて運用すれば、リスクは十分にコントロールできる。

特典

この記事で紹介した社内AI利用ガイドラインのテンプレート(Word形式)を用意した。自社名を入れて、項目を調整するだけで、そのまま社内に展開できる。導入検討時の稟議書に添付する資料としても使える。

→ 社内AI利用ガイドラインテンプレートをダウンロードする(無料) /resources

参考リファレンス

- Anthropic公式: 利用規約・プライバシーポリシー

- Anthropic公式ブログ: Claudeのセキュリティに関する説明

- Claude Works 関連記事: Claude Cowork とは|非エンジニアが今日から仕事に使えるAIアシスタントの全体像

- Claude Works 関連記事: Claude 料金プラン完全ガイド|無料・Pro・Team・Max・API、あなたに合うのはどれ?